达到1k stars后🥂,我对大模型开源教程的反思!

达到1k stars后🥂,我对大模型开源教程的反思!

Datawhale干货

作者:陈安东,Datawhale成员

前 言

“五·一”节后第一个开心的消息是我们开源的大模型基础项目(https://github.com/datawhalechina/so-large-lm)已经达到1k stars⭐️了。这个开源项目是为了提供浅显易懂且前沿的大模基础知识而打造的,能收获1k个stars⭐️也是对这个项目的肯定。我为一起付出努力的贡献者感到开心,也为这个课程的核心贡献者表达谢意。

作为该项目的一员,我将发起这个项目的初衷和打造项目时遇到的困难、解决方法等做以总结,希望可以给同样想以知识为切入点贡献大模型开源的朋友提供参考案例。话不多说,那我们开始吧。

蓄势待发

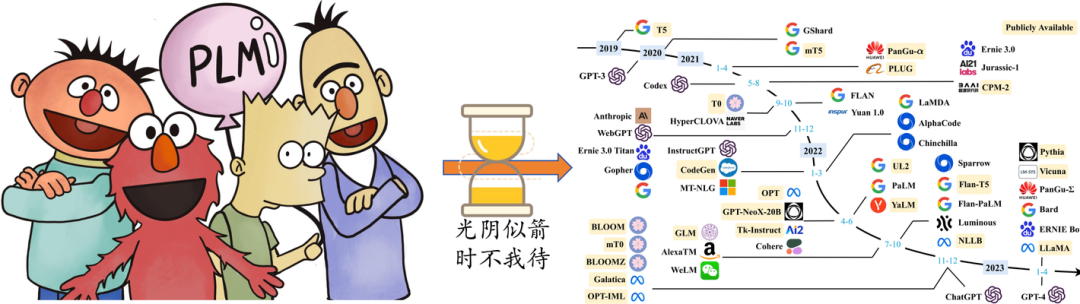

大模型时代的到来,让我们这些自然语言处理(NLP)的研究者/工程师感受到了如海啸般的冲击。在Scaling Law,语言模型(LM)和强化学习的极致组合下,大规模语言模型(LLM)在2022和2023年之交应运而生。

2019年中旬,我在某独角兽公司作为实习生已经开始调研预训练模型相关知识并着手训练GPT-3大小的中文预训练语言模型(PLM),到2023年中旬开始转向LLM的学术研究,有幸见证了大模型从混沌之初到拨云见日。

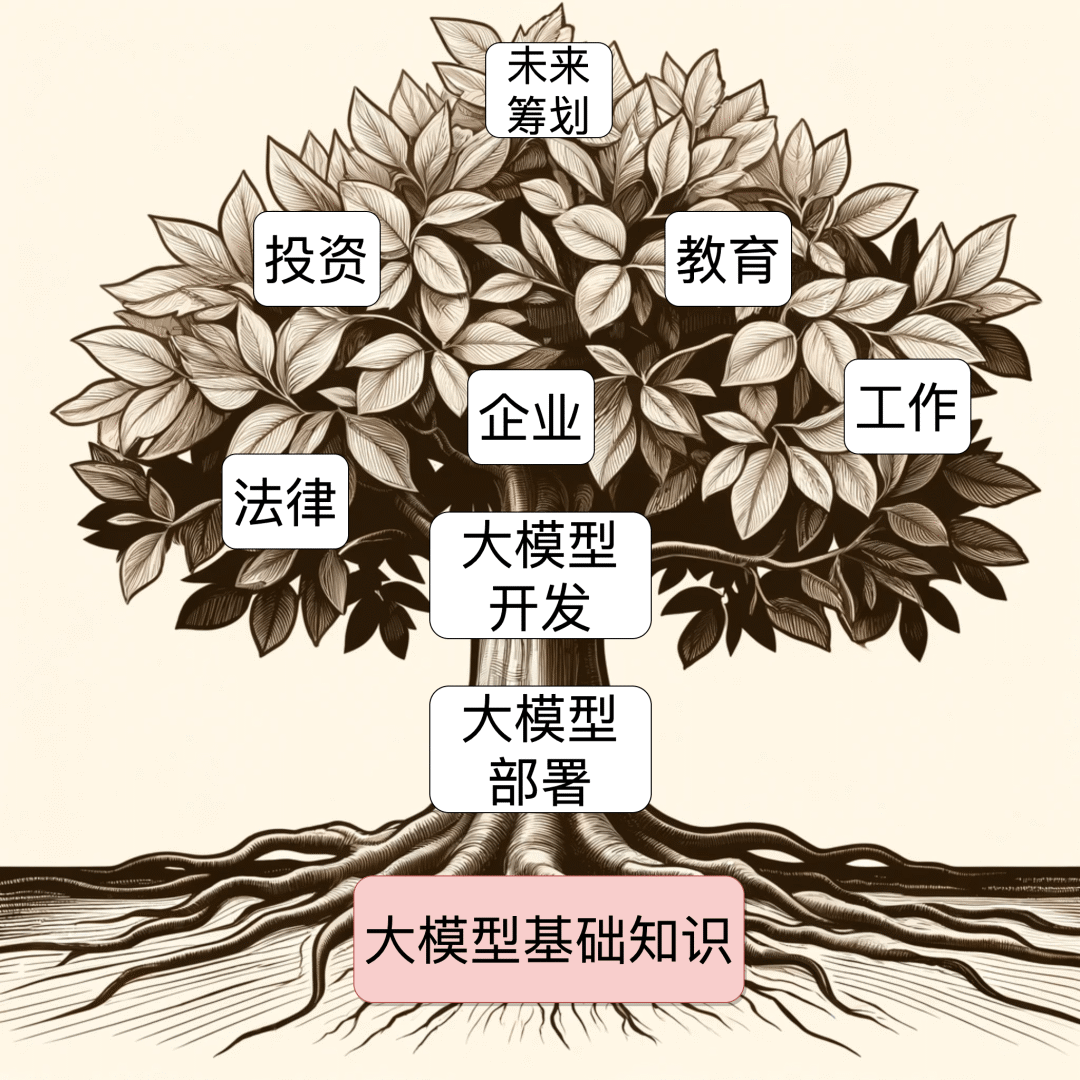

目前大模型正飞速向前发展,人工智能领域也迎来了一场深刻变革,尤其是NLP领域,层出不穷的模型架构、预训练知识、Prompt策略不仅推动了研究前沿(AlphaFold 3预测所有生命分子结构),也在医疗(GPT-4V,在回答带有图像的美国医学执照考试问题时,取得了62%的准确率)、法律(GPT-4 在每个律师资格考试中成绩超过了90%的考生)等领域展现出巨大的应用潜力。Llama、ChatGPT等开源或商用大模型的出现,直接改变了我们与信息知识交互的方式(谷歌和微软推出了基于大模型的搜索工具),大模型的影响已渗透到社会各个角落,成为公众讨论的焦点。

在这种环境下,系统、易懂且理论丰富的开源教程变得愈发重要。但是,信息获取渠道目前主要以实战和具体应用案例为主,而在理论深度和广度上往往不足,这是一个明显的现状问题。解决这个问题的方式是开发和推广更多涵盖理论基础和实践应用的综合教程,帮助研究者、企业家、从业者和公众深入了解大模型底层的原理、机制和对社会的影响。

初次尝试

在大模型这场技术和社会大课题下,我和Datawhale的小伙伴张帆一拍即合,决定通过开源的方式分享当前大模型的基础知识。经过多次讨论和分析,最终我们确定开源课程可以解决以下问题:

1. 知识传播的必要性

(1)由于大模型具有庞大的参数和复杂的技术架构,理解其工作原理并非易事。因此,介绍基础理论知识,有助于降低学习门槛,为更多人打开进入AI领域的大门。

(2)大模型技术的应用已经深入社会各个领域,包括生成式对话、内容创作、数据分析等。因此,对相关从业者和研究者来说,深入理解其理论基础显得尤为重要。这种深入的理解能让他们在应用这些技术时更具优势,例如可以更有效地将这些技术纳入企业战略规划和日常运营中。这不仅提升了技术应用的效果,也增强了企业和个人在竞争中的地位。

(3)随着技术的广泛应用,大模型的社会影响也引发了大量讨论。传播理论知识不仅能帮助公众更全面地认识大模型的能力和局限,还可以减少误解和偏见,促进公众对AI技术的理解和信任。

2. 当前社会的影响

(1)大模型生成的内容可能包含虚假信息或社会偏见,引发了法律和伦理问题,需要广泛的理论知识传播来提升公众认知,推动监管体系的完善。

(2)大模型的普及使许多传统工作岗位面临挑战,因此帮助从业者掌握大模型的基本知识与技能,促进就业和产业变化至关重要。

(3)大模型的开源促使更多研究者参与到相关技术的开发与创新中,加强了学术界与产业界的联系,推动技术创新和加速。

难题显现

尽管我们对这场大模型技术和社会变革怀有极大的热情,并希望通过开源课程推动知识传播和技术普及,但实际进展并不如预期顺利。在初步发布的课程中,我们遇到了很多的挑战和难题。

首先,大模型技术学习的 高门槛阻碍了参与者。尽管课程尽可能降低了对学员的要求,仍有大量学习者在面对大模型的庞大知识体系时望而却步。课程中涉及的技术细节和复杂概念让许多对该领域感兴趣的初学者难以深入理解,参与学习的动力不足。

其次,受众需求差异明显。开源课程面向的受众层次不一,包括学术研究者、企业家、技术从业者和普通爱好者等。在设计课程时,我们试图兼顾不同群体的需求,但实际效果却是由于难以平衡课程难度,导致各类学习者的参与度不高。

以上两个问题导致 开源项目参与度低。虽然我们希望通过开源方式吸引更多的开发者和学习者加入社区,共同完善课程内容和资源,但当时实际参与度远低于预期。许多学习者在学习过程中只浏览了课程的部分内容,而对开源项目的贡献和反馈寥寥,由于社区反馈不足,课程开发团队在课程迭代和改进上遇到阻力,内容改进方向模糊,难以确定课程内容的不足之处和改进方向。

破局

面对上述难题,我们意识到,仅凭一己之力很难实现课程的初衷目标。项目在24年前几个月经历了长时间的停摆,但是我们一直相信当前大模型的开源课程中缺少基础及理论的代表作,这件事是有意义的。年后我和项目另一位的构建者张帆长谈,针对当前困境展开了深刻的思考与讨论。分析当前的困境和我们能做的努力,在接下来的课程开发和推广中,我们做了如下改变:

首先课程难度把控,在当前的课程中我们降低了初学者的学习门槛,在新更新的内容中将复杂的数学公式以一种通俗易懂方式进行讲解。

其次更新前沿知识,为满足高水平学习者的广度需求,我们提供更加前沿的大模型知识,用通俗的方式讲给高水平学习者,来帮助他们获取一手的大模型最新动态。

然后加强社区互动,我们积极回复GitHub的issue,并积极引导学习者参与开源项目,提供问题反馈、课程建议和贡献机会。

举个例子,我们在LLAMA3发布的第三天,从基础知识的角度梳理了该模型的技术细节和亮点,并将其与前两代模型进行对比。该工作在开源项目和Datawhale公众号同步分享(【独家】万字长文带你梳理Llama开源家族:从Llama-1到Llama-3),还有B站视频讲解的版本供大家学习:

https://www.bilibili.com/video/BV1Xi421C7Ca

我们相信,大模型基础知识的更新是螺旋上升的,基础知识可以让这个时代的人更加从容地理解新的大模型带来的冲击,学会更好地利用大模型

新的旅程

目前大模型基础课程发布半年达到1k stars⭐️,我们知道旅途还未结束,之后还更多的路要我们前行。我们进行了深入反思,明确了努力的目标。

1. 持续并快速更新,大模型技术日新月异,需要及时更新课程内容以反映最新的研究和应用进展,保持课程的前沿性与实用性。

2. 理论与实践相结合,理论知识需要与实践技能相结合,后期会提供具体的项目代码,使学习者能够将理论知识应用于实际项目,提高整体能力。

3. 反馈与社区互动,听取学习者的反馈,持续优化课程内容,增强与开源社区的互动,与更多的开源者共同完善教程体系。

路漫漫其修远兮,吾将上下而求索。大模型时代已来,吾辈持续成长,希望为这个时代做些贡献